Google öffnet Zugang zum 2-Millionen-Token-Kontextfenster des Gemini 1.5 Pro AI-Modells

Google hat bekannt gegeben, dass das 2-Millionen-Token-Kontextfenster des Gemini 1.5 Pro AI-Modells nun allen Entwicklern zugänglich ist. Dies stellt einen bedeutenden Fortschritt in der Entwicklung und Nutzung von AI-Modellen dar, da zuvor der Zugang nur über eine Warteliste verfügbar war.

Das 2-Millionen-Token-Kontextfenster ermöglicht es Entwicklern, größere Datenmengen gleichzeitig zu verarbeiten. Dies ist besonders nützlich in Bereichen wie Natural Language Processing (NLP), wo der Kontext entscheidend für die Genauigkeit und Relevanz der Ergebnisse ist. Entwickler können nun umfangreichere Dokumente und längere Konversationen in ihren Modellen verwenden, was zu besseren und präziseren Ergebnissen führt.

Darüber hinaus hat Google Entwicklern den Zugang zu den Code-Ausführungsfunktionen in der Gemini-API ermöglicht, und das Gemma 2-Modell ist im Google AI Studio verfügbar. Diese Erweiterungen wurden am 27. Juni bekannt gegeben und bieten Entwicklern neue Werkzeuge und Funktionen, um ihre AI-Projekte zu optimieren und zu erweitern.

Mit der Öffnung des Kontextfensters auf 2 Millionen Token können Entwickler komplexe Eingaben und Analysen durchführen. Ein größeres Kontextfenster bedeutet, dass das Modell mehr Informationen gleichzeitig verarbeiten kann, was zu präziseren und umfassenderen Ergebnissen führt. Dies ist besonders nützlich für Anwendungen, die große Mengen an Text verarbeiten oder umfangreiche Datenanalysen erfordern. Ein praktisches Beispiel dafür wäre die Analyse von Forschungsartikeln, bei denen es wichtig ist, den gesamten Kontext zu verstehen, um relevante Informationen zu extrahieren.

Erweiterte Funktionen und Kostenmanagement

Google betonte jedoch, dass mit dem Wachstum des Kontextfensters auch das Potenzial für höhere Eingabekosten steigt. Um Entwicklern zu helfen, Kosten zu senken, hat Google das sogenannte „Kontext-Caching“ eingeführt. Diese Funktion ist sowohl für Gemini 1.5 Pro als auch für Gemini 1.5 Flash verfügbar.

Das Kontext-Caching ermöglicht es Entwicklern, einmal verwendete Tokens effizient wiederzuverwenden, was zu einer erheblichen Kostensenkung bei wiederholten Aufgaben führt. Diese innovative Funktion zeigt Googles Engagement, Entwicklern nicht nur leistungsfähige Werkzeuge, sondern auch wirtschaftliche Lösungen anzubieten. Kostenmanagement ist ein kritischer Aspekt der Entwicklung und Nutzung von AI-Modellen, und Google setzt hier einen wichtigen Schritt, um die Nutzung seiner Dienste erschwinglicher zu machen.

Ein weiteres Beispiel für die Vorteile des Kontext-Cachings ist die Nutzung in Chatbots und Kundendienstsystemen. Hier können wiederkehrende Benutzerinteraktionen effizienter verarbeitet werden, da der Kontext der vorherigen Unterhaltungen gespeichert und wiederverwendet wird, was die Betriebskosten senkt und die Benutzererfahrung verbessert.

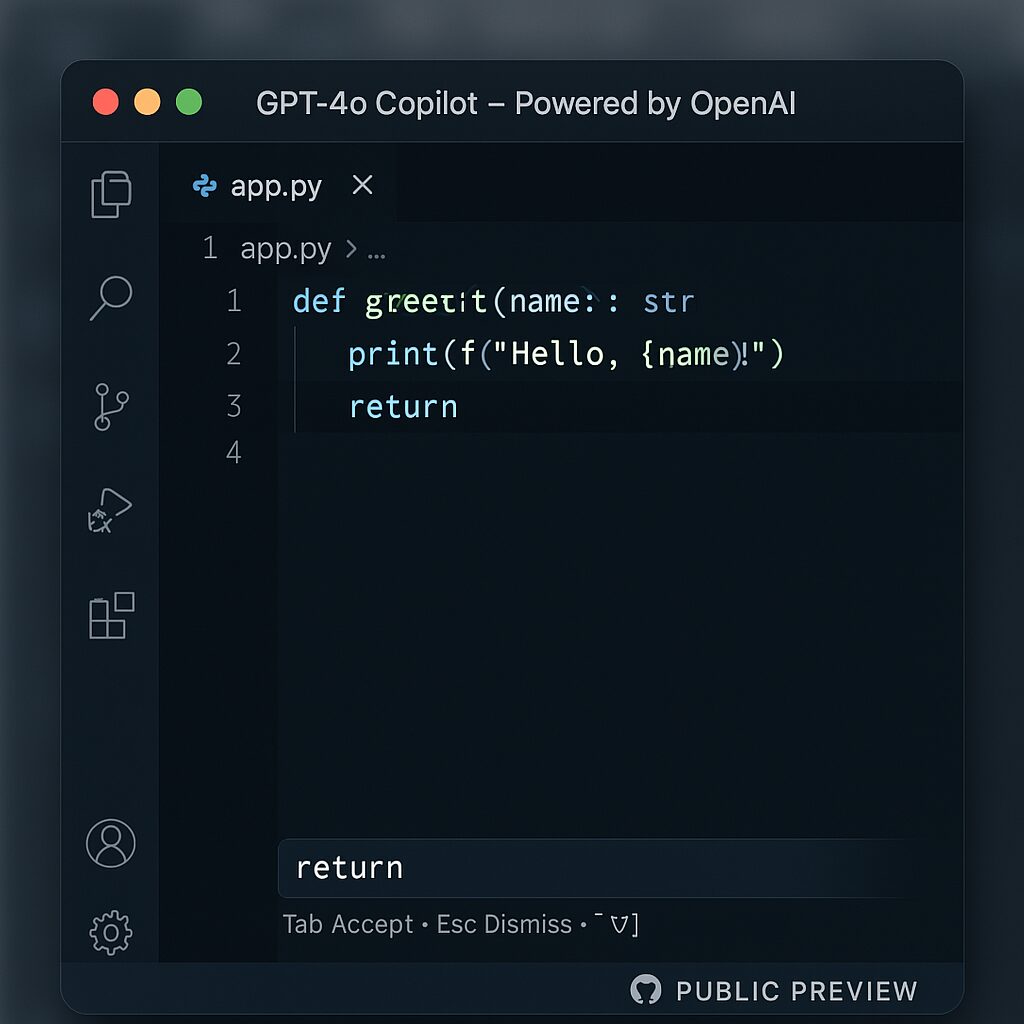

Aktivierung der Code-Ausführung

Um die Fähigkeiten zur mathematischen und datenbasierten Argumentation weiter zu verbessern, hat Google die Code-Ausführung in Gemini 1.5 Pro und Gemini 1.5 Flash aktiviert. Diese Funktion ermöglicht es dem Modell, Python-Code auszuführen und iterativ aus den Ergebnissen zu lernen, bis eine gewünschte Eingabe erreicht ist. Dies stellt einen bedeutenden Fortschritt dar, denn es ermöglicht Entwicklern, komplexe Berechnungen und Analysen direkt im Modell durchzuführen.

Die Code-Ausführung ist über die Gemini-API und im Google AI Studio unter „Erweiterte Einstellungen“ verfügbar. Dies markiert den ersten Schritt in der Integration von Code-Ausführung als Modellfunktion, die in Zukunft weiter ausgebaut werden soll. Die Möglichkeit, Code direkt im Modell auszuführen, eröffnet Entwicklern neue Wege, um ihre Anwendungen zu optimieren und komplexe Probleme zu lösen.

Ein Anwendungsfall für diese Funktion ist die Erstellung von Modellen für Finanzprognosen. Hier kann das Modell Finanzdaten analysieren, Berechnungen durchführen und Vorhersagen treffen. Dies ermöglicht es Finanzanalysten, präzisere und fundiertere Entscheidungen zu treffen.

Verfügbarkeit des Gemma 2-Modells

Google hat zudem angekündigt, dass das Gemma 2-Modell im Google AI Studio für Experimente bereitsteht. Dies ermöglicht es Entwicklern, mit dem neuesten Modell zu arbeiten und dessen Fähigkeiten in verschiedenen Szenarien zu testen. Das Gemma 2-Modell repräsentiert die neueste Generation von AI-Modellen bei Google, und es bietet verbesserte Leistung und erweiterte Funktionen im Vergleich zu seinen Vorgängern.

Zusätzlich wird an der Bereitstellung von Tuning-Funktionen für Gemini 1.5 Flash gearbeitet. Das Text-Tuning in Gemini 1.5 Flash ist jetzt bereit für Red Teaming und wird schrittweise allen Entwicklern zur Verfügung gestellt. Bis Mitte Juli sollen alle Entwickler Zugang zum Gemini 1.5 Flash Tuning über die Gemini-API und im Google AI Studio haben.

Text-Tuning ist ein entscheidender Prozess, der es Entwicklern ermöglicht, die Ausgabe ihrer AI-Modelle feinzustimmen. Das Tuning verbessert die Genauigkeit und Relevanz der generierten Texte und ist ein wesentlicher Bestandteil der Entwicklung leistungsfähiger AI-Anwendungen. Ein Beispiel ist die Anpassung von AI-Textgeneratoren für spezifische Branchen, wie juristische oder medizinische Texte.

Zusammenarbeit und Community-Engagement

Google fördert aktiv die Zusammenarbeit und den Austausch innerhalb der Entwicklergemeinschaft. Durch die Bereitstellung dieser erweiterten Funktionen lädt Google Entwickler ein, innovative Anwendungen zu erstellen und ihre Erkenntnisse mit der Gemeinschaft zu teilen. Diese kollaborative Herangehensweise stärkt das gesamte Ökosystem und fördert den Fortschritt in der AI-Forschung und -Entwicklung.

Darüber hinaus organisiert Google regelmäßig Workshops, Webinare und Konferenzen, um Entwicklern die neuesten Technologien und Best Practices vorzustellen. Diese Veranstaltungen bieten eine Plattform für den Austausch von Ideen und die Diskussion neuer Trends im Bereich der künstlichen Intelligenz. Beispiele sind die Google I/O und AI Summits, bei denen Experten aus der ganzen Welt zusammenkommen, um Wissen zu teilen.

Fazit

Die neuesten Ankündigungen von Google markieren einen bedeutenden Fortschritt in der Entwicklung von AI-Technologien. Mit dem erweiterten Zugang zum 2-Millionen-Token-Kontextfenster des Gemini 1.5 Pro AI-Modells zeigt Google sein Engagement, Entwicklern leistungsfähige und innovative Werkzeuge zur Verfügung zu stellen.

Diese Entwicklungen eröffnen neue Möglichkeiten für die Anwendung von AI in verschiedenen Bereichen. Entwickler haben nun mehr Werkzeuge, um ihre Projekte voranzutreiben und die Grenzen der AI-Technologie weiter zu verschieben. Insgesamt unterstreichen diese Schritte Googles Führungsposition im Bereich der künstlichen Intelligenz. Sie bieten der Entwicklergemeinschaft erweiterte Möglichkeiten, um innovative und effiziente Lösungen zu entwickeln.

Es bleibt abzuwarten, wie die Entwicklergemeinschaft diese neuen Werkzeuge nutzen wird, aber die bereitgestellten Ressourcen versprechen eine aufregende Zukunft für AI-Entwicklungen. Entwickler weltweit sind gespannt auf die Möglichkeiten, die sich bieten. Google setzt weiterhin Maßstäbe in der Bereitstellung von erstklassigen AI-Lösungen.

Mit diesen neuen Ankündigungen zeigt Google erneut seine Fähigkeit, den Bedürfnissen der Entwickler gerecht zu werden. Die Zukunft der AI ist vielversprechend, und Google bleibt ein zentraler Akteur in diesem sich schnell entwickelnden Feld.

Zusammenfassend lässt sich sagen, dass Google durch diese Innovationen seine Position als führender Anbieter von AI-Technologien stärkt. Die gesamte AI-Entwicklergemeinschaft wird ermutigt, neue und aufregende Anwendungen zu schaffen. Dies könnte zu bedeutenden Durchbrüchen in verschiedenen Branchen führen. Die Zukunft der künstlichen Intelligenz sieht dank der Fortschritte und des Engagements von Unternehmen wie Google sehr vielversprechend aus.